February 28, 2023

清水 亮 ryo_shimizu

新潟県長岡市生まれ。1990年代よりプログラマーとしてゲーム業界、モバイル業界などで数社の立ち上げに関わる。現在も現役のプログラマーとして日夜AI開発に情熱を捧げている。

先日、秋葉原の3331で開催されたテクノエッジ主催イベントでは、StableDiffusionを開発したStability.AIのジェリー・チーさんと、THE GUILDの深津貴之さんと筆者の三人で鼎談した。

残念ながらイベントのアーカイブは残っておらず、80人の席は全て即完売。

改めて考えると、会場が小さすぎるしチケットが安すぎる。

まあそれはいいとして、懇親会ではTwitterやnoteでしか見たことがなかった生成AI業界のスターたちに挨拶できて非常に嬉しかった。

講演の感想をいただく中で、「Scaling Lawについての話が一番面白かった」と言われたので、昔もこの連載でとりあげた気がするが、再度この段階で振り返っておくことにする。

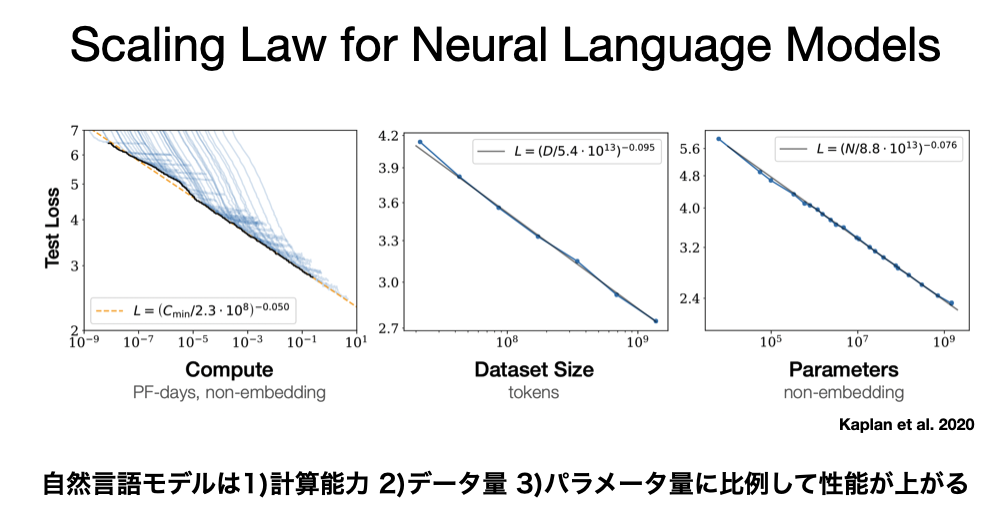

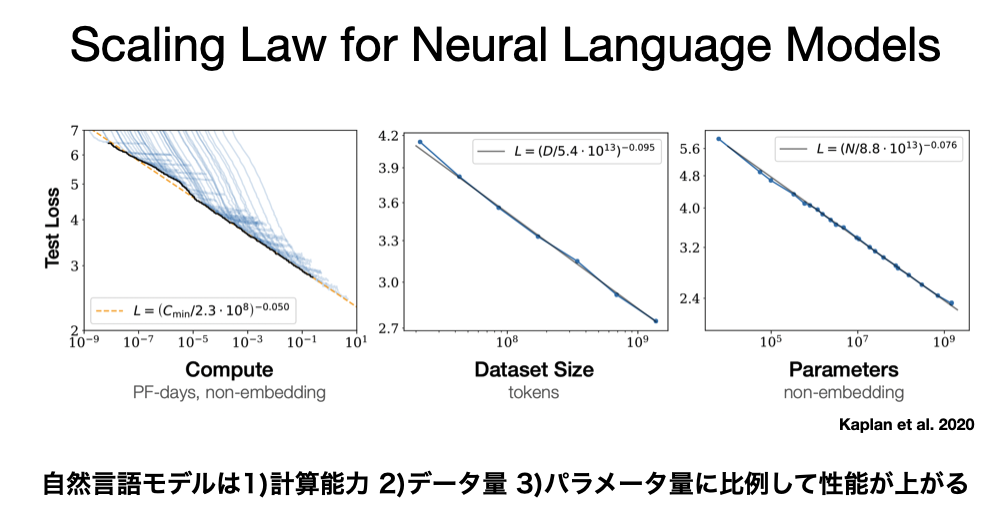

「Scaling Law(スケールの法則)」とは、2020年に出された論文のタイトルである。

この法則によれば、言語モデルは、計算能力、データ量、パラメータ量に比例して性能が上がって行く。

しかも、言語だけでなく、言語モデルを応用したマルチモーダルな変換、つまり、「言葉から画像」を生成したり、「数式から正解」を生成したりするタスクにおいても、全て線形に性能が向上することがわかった。

しかし、筆者は長年の経験からひとつとてもあたり前のことを知っている。

「線形な進化が見えてきたら前提を疑え」というものだ。

なぜならば、「線形な進化」をしている状態というのは、研究としては停滞している状態だからだ。

「もっと速いコンピュータ、もっとたくさんのデータ、もっとたくさんのパラメータ」だけを追求するというのであれば、それはもやソフトウェア技術ではない。

ソフトウェアとは、発想の工学である。

線形な進化をしている状態というのは、発想が枯渇している状態であるとも言える。

線形に進化しているように見えるものは、重大な見落としをしている。

もしくは、その進化が素朴すぎて全体の可能性のごく一部だけを見ている可能性が高い。

線形な進化に委ねるというのは、ソフト屋の発想ではない。

実際に、ここで高められている「精度」とは何を根拠にしているのかというと、かなり素朴な問題に対する答えである。

こんな程度の問題は、さほど高度な知能をもっていなくても、英語さえできれば小学生でも解ける。

ChatGPTに難問をぶつけたくなる人類は非常に興味深い。どこかで本能的に「自分を超える知能」であることを期待しているのだ。

普通の人は、ChatGPTになんと問いかけるべきかわからなくて戸惑う。

それは、最初にロボット型検索エンジンが出てきたときにも同じように感じたはずだ。

筆者も最初に見た時はそうおもった。

NASAのサイトにいきたければ、URLにnasa.govと打てばいい。

わざわざロボット型検索エンジンを間に挟む理由がわからない、と。

この時代、URLが非常に大切なものとされた時代である。

打ち込みやすいURLや、覚えやすいURLがないとダメだと。

筆者も「携帯電話で打ち込みやすい」という理由で、m.aj.toというドメインを持っていた。当時の携帯電話は、ABC、DEF、GHI、JKL、MNO,PQRS、TUV,WXYZといった感じで分かれていた。

先頭の文字だけでドメインを作ると携帯で打ち込みやすい。majtは全て最初の文字だ。Oだけが違うが、この時手軽に取れる外国のドメインはそんなになかった。

なぜそんなことが大事だったかというと、携帯電話には検索エンジンがなかったからだ。

ちなみに同じ発想で社名がつけられたのがJAMDATというシリコンバレーのゲーム会社である。

なのにいつのまにか・・・まあ起源は正確にわかっている。2007年のiPhone発売だ・・・我々はスマホで検索を多用するようになっていた。全ての入口と出口が、スマホになった。

2004年ごろまで、僕はGoogleを使ってなかった。必要性がわからなかった。「ああ、ちょっと速いね」くらいだ。

「ページランクが凄いんだよ」と言われても、さっぱりだった。

「”ホワイトハウス”で検索すると、whitehouse.govが出てくるのが凄いんだ。他の検索サービスではぜんぜん違う記事が出てきてしまう」

「ホワイトハウスのページに行きたかったら、最初からURLにwhitehouse.govと打ち込めばいいじゃないか」

そう反論したのだが、そのときは僕が間違っていた。

誰も首相官邸がkantei.go.jpだなんてことを覚えたくはないのだ。

そのくせ、ChatGPTは盛大に間違う。

これを根拠として、実はPerplexity.aiのほうがいいんだ、という主張もある。

Perplexity.aiはたしかにいい。

確かにいいのだが、僕はまだあれをファーストページにしていない。

試しにPerplexity.aiに「首相官邸」と打ってみた。

ああなるほど。確かに。

これは使えんわ。中国語と日本語の区別もつかないとは。

ソースを見ると、Baiduの方が先にきている。

日本人が日本語環境から日本のIPアドレスで検索しているのにBaiduを優先するのはまだまだ作り込みが甘い。

僕が英語を第一言語としていたら、もう少し使いでがあるだろうか。

試しに自動翻訳してみたらどうだろうか

無惨。

朝鮮官邸になってしまった。

永田町なのに。

ChatGPTに対する過大な期待が広まる中で、大きな誤解も生まれている。

そのひとつが、「スケールの法則」に対する盲信だ。

「いつかGPT-4、GPT-5、GPT-10くらいになれば、人間と同等以上の賢さになるはずだ」と思っている素朴な人があまりにも多い。

けれども、筆者の考えでは、そういう未来は来ない。

GPTシリーズがどれだけ進化しようとも、そもそも学習すべき文書データが枯渇している。

これ以上パラメタの規模を大きくしても、それほど賢くなるわけではない。

さっきも言ったように、GPTシリーズが線形に進化しているように見えているのは、むしろ停滞しているからだ。

ChatGPTは、GPTシリーズをそのまま使うのではなく、強化学習と組み合わせることでこの問題を突破しようとした。

GPT3を連鎖させるLangChainや深津さんのMAGIシステムのようなアプローチも同様で、この方法は非線形なので限界を突破できる可能性があるし、実際に突破しているようにも見える。

つまり、「停滞している」という考えをOpenAIが持っているから、強化学習の組み合わせ、という非線形な進化を試みているのである。これは重大な違いであるにも関わらず、素人はともかく専門家を自称する者までもが、「GPT3.5を使っているからChatGPTと同じ」という勘違いを流布している。それは「iPhoneは携帯電話だからiモードと同じ」と言うくらいに間違っている。

技術の進化というのは非連続的に起きる。

昔ながらのガラケーとiPhoneを並べて、これが線形な進化の結果だとは思えないだろう。

もちろんiPhoneは、iモードをよく研究して作られている。

その意味では全く無関係ではない。ある種の「延長線上」にあるものであるのは間違いない。

しかし、iモードとiPhoneは、「全く違う」

技術を延長するのは当然として、新しいものが生まれるためには、少なくとも「非線形に見える」ことは大事なのだ。

ChatGPTの新しいところは、ほとんどユーザーインターフェースだけといってもいい。もちろん強化学習との組み合わせは新しいのだが、強化学習された結果獲得したものが、ほとんどユーザーインターフェースの部分に終始しているように思える。

何を言ってるかというと、ChatGPTが毎回いともあっさりと「すみません。私はそのように作られていません」と答えることだ。これはChatGPTそのものよりももっと素朴なプログラムでいくらでも再現できるのだが、ChatGPTではあえて強化学習という、べらぼうにコストの高い方法で実現している。

また、僕が不思議なのは、ChatGPTをなぜかみんな巨大な言語モデルでしか動かしていないことだ。

ChatGPTの構造は、もともと言語モデルに強化学習を組み合わせたものだ。

だとすれば、もっと小さい言語モデルと強化学習を組み合わせてもいいではないか。

ChatGPTが見事な答えを返すように見えるのは、そのように強化学習されているからだ。

ということは、その強化学習に使われた「判別器」はGPT3よりずっと小さいはずである。

ChatGPTも強化学習を使っている以上、一種のモンテカルロ木探索を使って作られているはずである。

この探索木は本来の言語モデルに比べればもっとずっと小さくできる。大きくすることもできるが、大きいモデルではあのスピードで返答することはできないから、本体に比べてかなり小さいはずだ。

そして、かなり小さい言語モデルの場合、強化学習そのものが無謀なほど大変とはどうしても思えない。

なぜ誰も、ChatGPTの小さめのクローンを作ろうとしないのだろうか。

Stability.AIが準備中のチャットボットもなかなか出てこないようだし、どうも勿体無い、という気がする。

ただ、一方で、これにお金を出してくれる投資家を探すのは大変そうだ。

いつ、どのようにお金になるか全く予想がつかないからだ。

この進化は非線形であり、非線形な進化というのは、もともと予想がつかないからおきる。

Googleが必要だと僕が気づいたのは、Googleがサービスを開始してから6年くらいしてからだった。

その頃のGoogleは、スタンフォード大学の教員が学生寮でこっそり運営していた。僕らもそういう時代を六年くらいは過ごさないといけないのかもしれない。